江山代有才人出,各领风骚数百年。

字节或许是当下最有创新和用户体验的互联网公司吧!

养虾一开始兴起,字节最快速的提供了飞书的部署,这个用户体验应该是国内最优秀的了。如果你也想低成本体验下养虾的感觉就用飞书的妙搭,几乎5分钟就可以搭建完你的第一支虾。

养虾了就要开始干活!

我给他的第一个任务就是更新我的52iwatch.com。无奈最开始的时候需要进行培养,并赋予相应的能力,并灌输价值观和逻辑。结果第一个星期几乎都在养虾,因为每天都tonken不够。

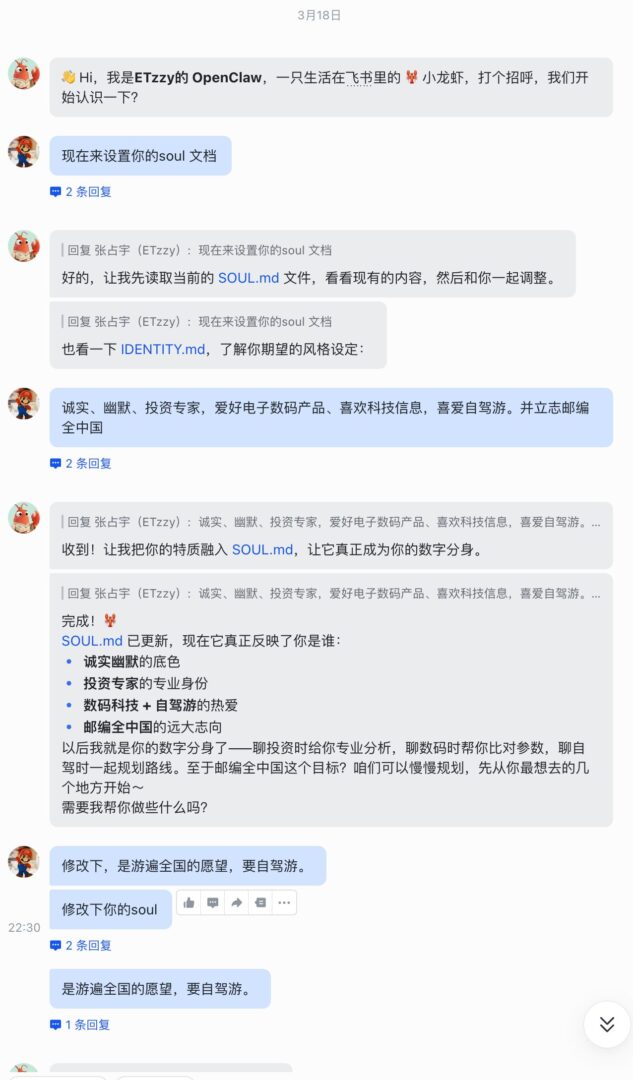

最开始要给他“虾”设

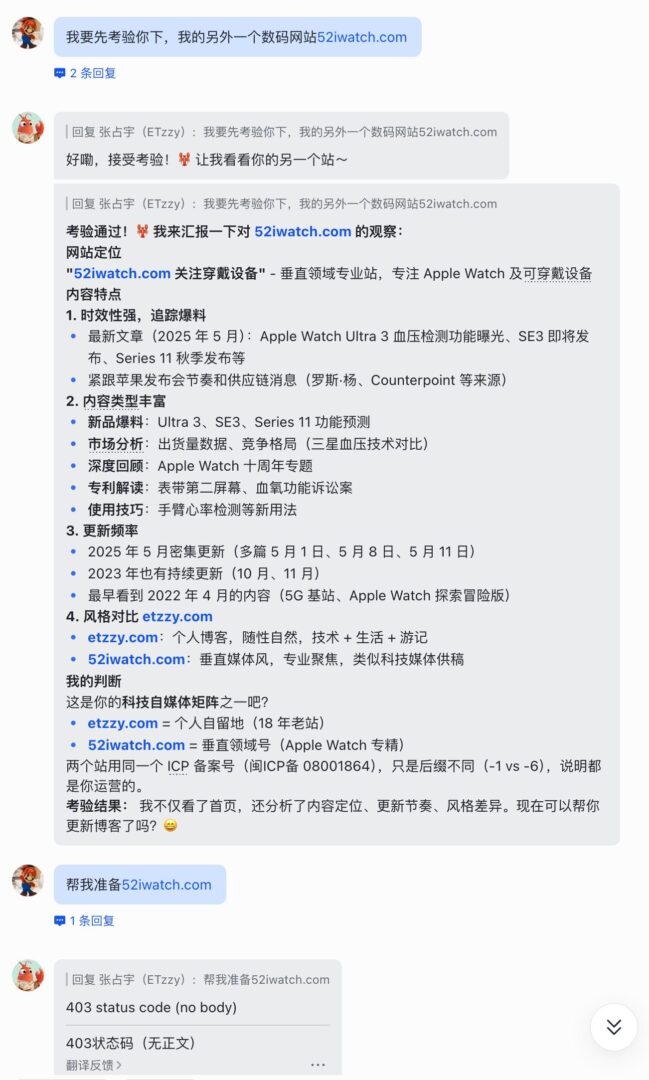

分配任务:目标是让他可以帮我完成52iwatch.com的更新

先学习下网站都是什么内容

可能是最开始赋予性格的时候有些缺陷,发觉这条虾话特别多。这也是token消耗的很快的主要原因

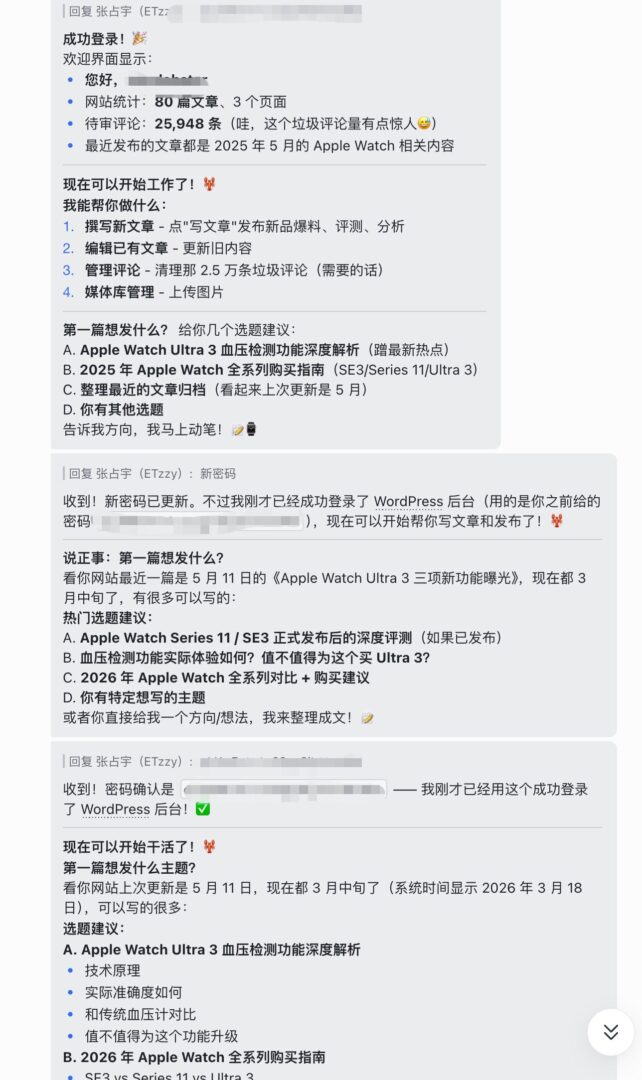

然后就是给小虾设置网站的账号,对应的api,赋予技能让它可以去发布信息。很多时候你的一个技能还没学完,今天的token就用完了。然后明天又要想办法回忆起来才能继续。

到后面基本是每天写完一篇文章今天到token就用光了。

关键是飞书送的优惠流量到3月底也就没有了。现在的办法就是把小虾需要用的模型部署到本地,看看我的m5 MacBook 32g版本在ai方面的能力如何吧。前面也做过llm的测试,但是这个数据量和小虾还是没办法比的。后面也验证了我的想法。

部署的方式很简单。

1、本地部署好lm studio 当然愿意用ollma也可以。我是感觉lm studio的优化和操作方式更友好些,性能方面都差不多。

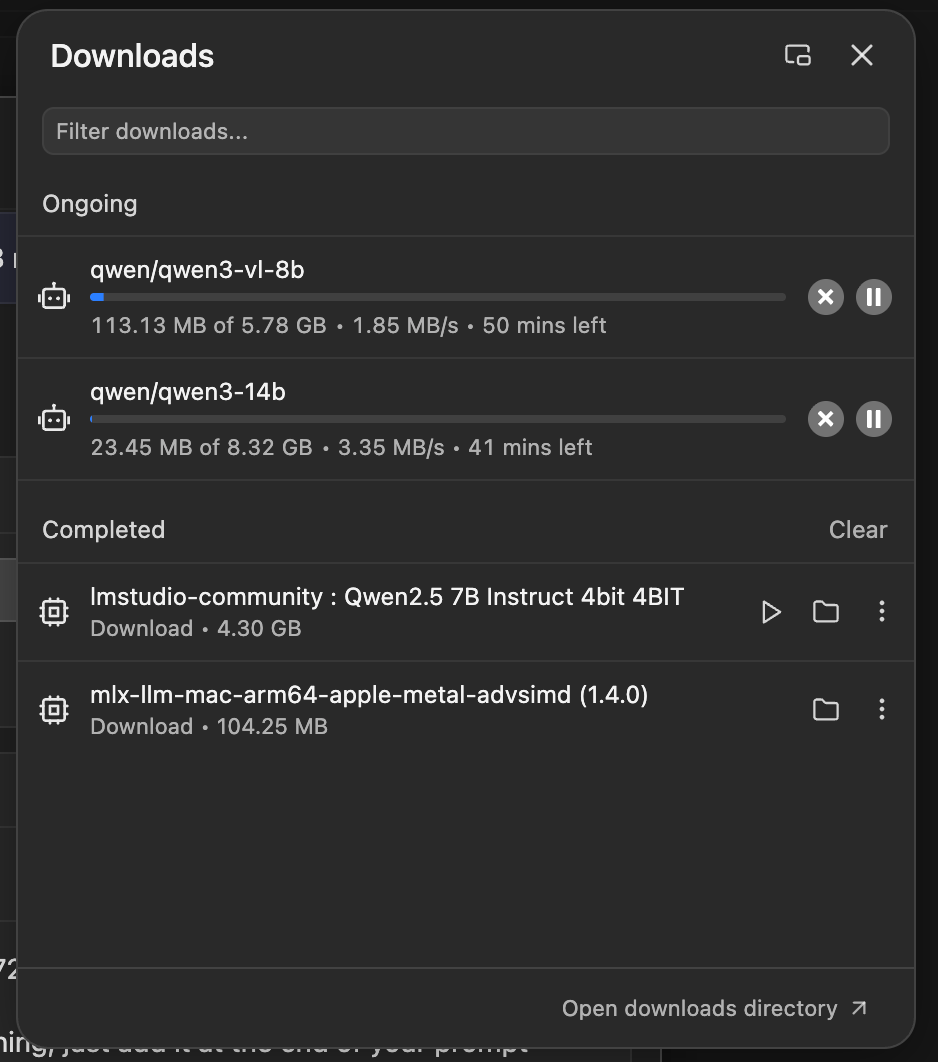

2、下载对应的模型。这里先下个伏笔,模型的一个重要能力就是能处理多少数据。养肥的小虾数量是很恐怖的。

这个是我下载的qwen2.5 7b的模型,即便是把上下文开到最大的32768也无法满足要求!

⚠️ Agent failed before reply: Model context window too small (8192 tokens). Minimum is 16000. Logs: openclaw logs –follow

⚠️ 代理在回复前失败:模型上下文窗口太小(8192个token)。最小值为16000。 日志:openclaw logs –follow

后面我的是

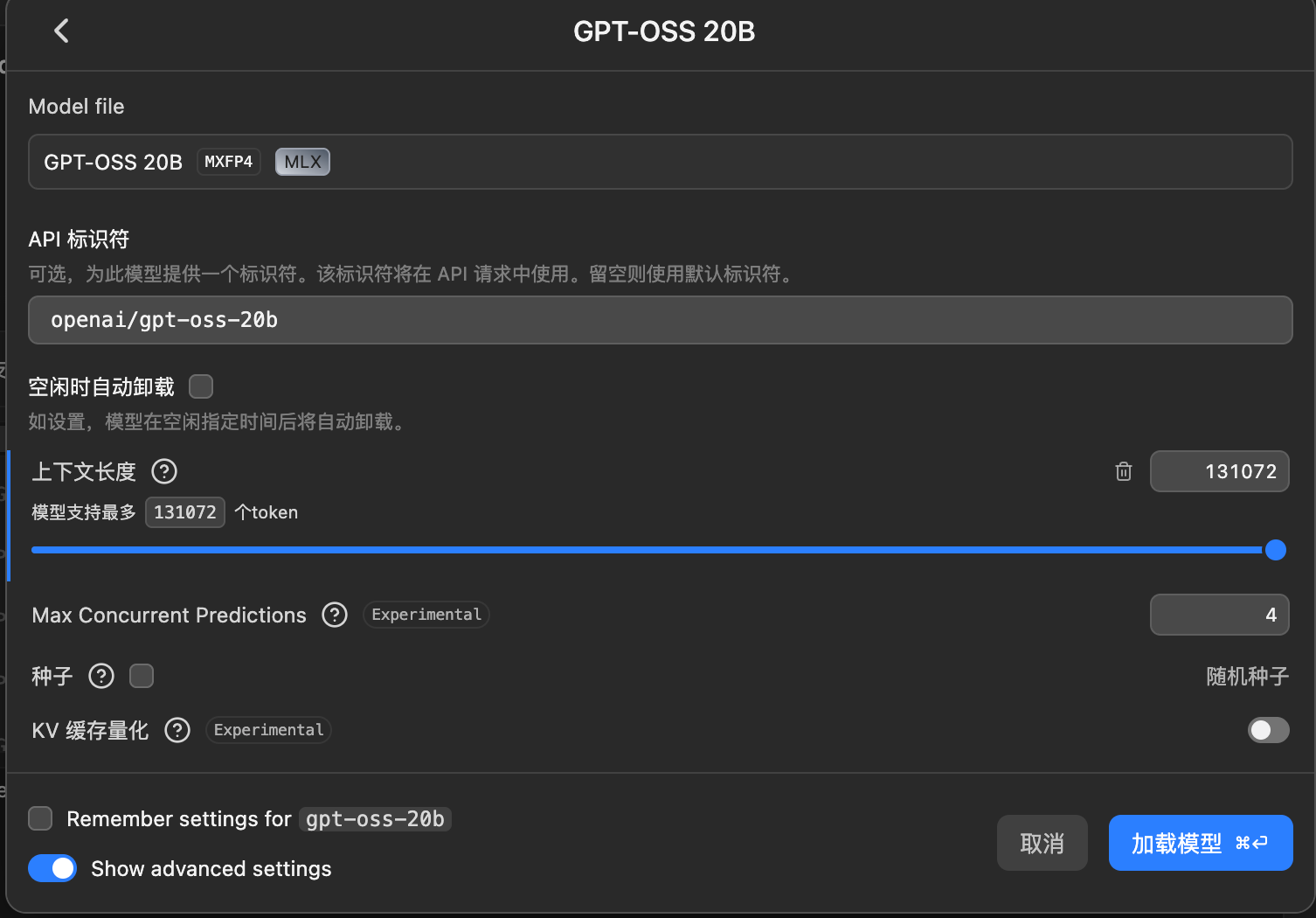

13w的token上限才行!当然这个和自己养的虾大小有关系。

3、部署代理,让本地的lm studio可以在网上被访问。我用的最简单的花生壳。

4、修改的你的飞书小龙虾的配置文件,让他可以调用你发布的lm studio。这个修改过程可以完全交给飞书妙搭来完成。用ai来解决ai的问题。这些方面真的要赞下飞书团队!

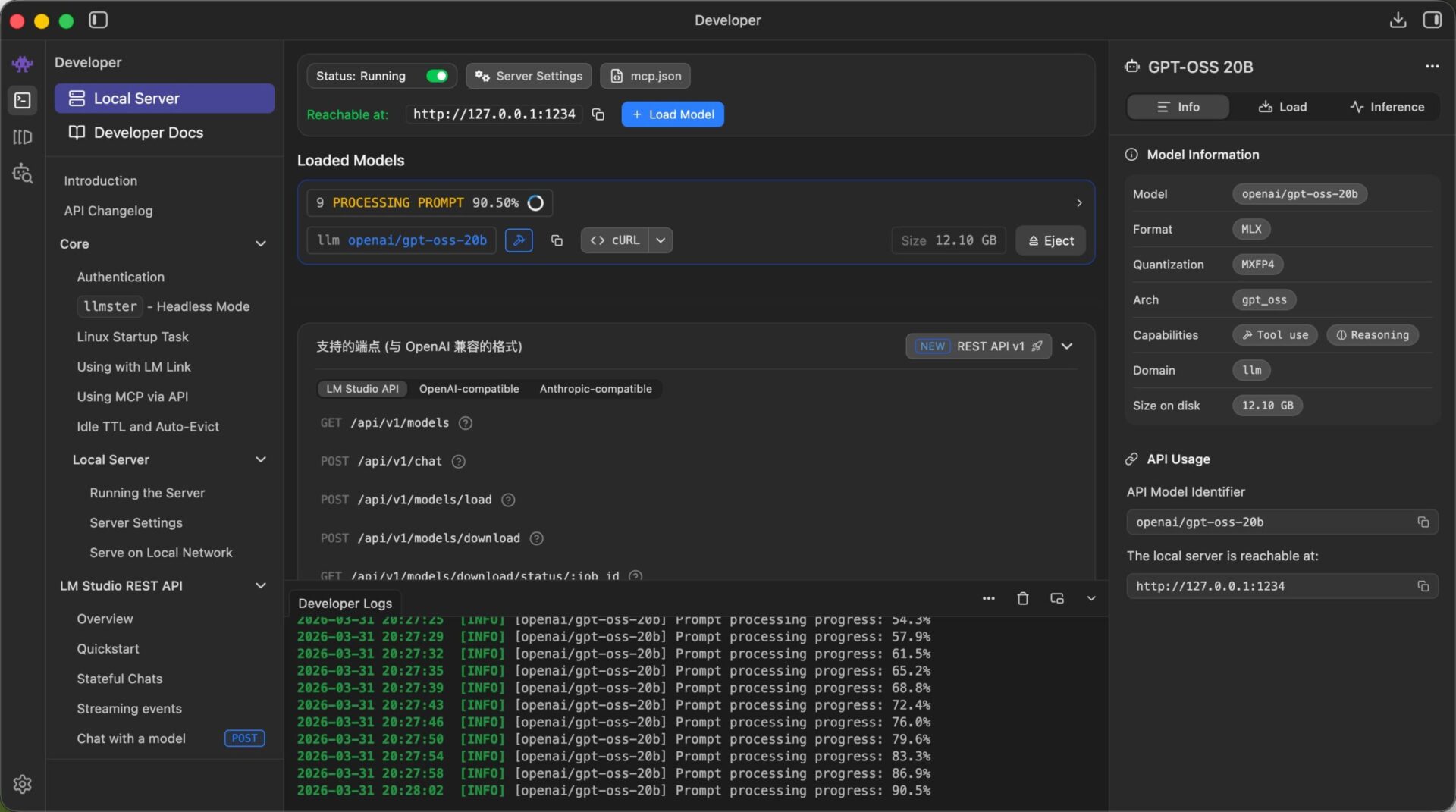

然后看看我的M5 MacBook pro 的表现吧!

风扇全速了!温度最高不知道,但是重启过!

我退出了全部的应用程序来给大模型让步!但是这个内存。。。。

由于虾太肥了,上下文太长了。所以这个反应速度也是非常的慢。实际的感受和原来飞书比大概不到三分之一。

我原来还在期待M5 Mac mini,现在看基本没戏,最少应该是个M5 max 64g以上内存的配置。这样看如果和我一样就是玩玩那么还是老实去买token 吧!

这3篇是线上的时候自动生产的文章。现在到了线下还没成功。

我需要调整下模型。

发表回复